MCP: Tại Sao Cộng Đồng AI Đột Nhiên Phát Sốt Với Giao Thức Này?

Giao thức Bối cảnh Mô hình (MCP) được Anthropic công bố từ cuối 2024 nhưng chỉ thực sự bùng nổ đầu 2025. Cùng tìm hiểu MCP là gì, tại sao nó lại hot đến vậy, và nó thay đổi cuộc chơi AI tự chủ như thế nào.

MCP: Tại Sao Cộng Đồng AI Đột Nhiên Phát Sốt Với Giao Thức Này?

"Ngay cả những mô hình tinh vi nhất cũng bị hạn chế bởi sự cô lập khỏi dữ liệu – bị mắc kẹt sau các silo thông tin và hệ thống kế thừa." – Đây là lời nhận định của Anthropic về tầm quan trọng của việc tích hợp ngữ cảnh, và nó đã chạm đúng vào "nỗi đau" của ngành AI hiện nay.

Các Mô hình Ngôn ngữ Lớn (LLM) ngày nay cực kỳ thông minh khi hoạt động độc lập, nhưng chúng lại gặp khó khăn ngay khi cần thông tin vượt ra ngoài dữ liệu huấn luyện "đông cứng" của mình. Để các tác nhân AI (AI agents) thực sự hữu ích, chúng phải truy cập đúng ngữ cảnh vào đúng thời điểm – dù đó là tệp của bạn, cơ sở kiến thức, hay công cụ – và thậm chí thực hiện các hành động như cập nhật tài liệu hoặc gửi email dựa trên ngữ cảnh đó. Trong lịch sử, việc kết nối một mô hình AI với tất cả các nguồn bên ngoài này là một công việc lộn xộn, đặc thù, khiến các tích hợp trở nên mong manh và khó mở rộng.

Để đơn giản hóa điều này, Anthropic đã giới thiệu Giao thức Bối cảnh Mô hình (Model Context Protocol - MCP) – một tiêu chuẩn mở được thiết kế để làm cầu nối giữa trợ lý AI với thế giới dữ liệu và công cụ. Họ công bố nó vào tháng 11 năm 2024. Phản ứng ban đầu? Khá là... "ờ thì..." (sort of blah).

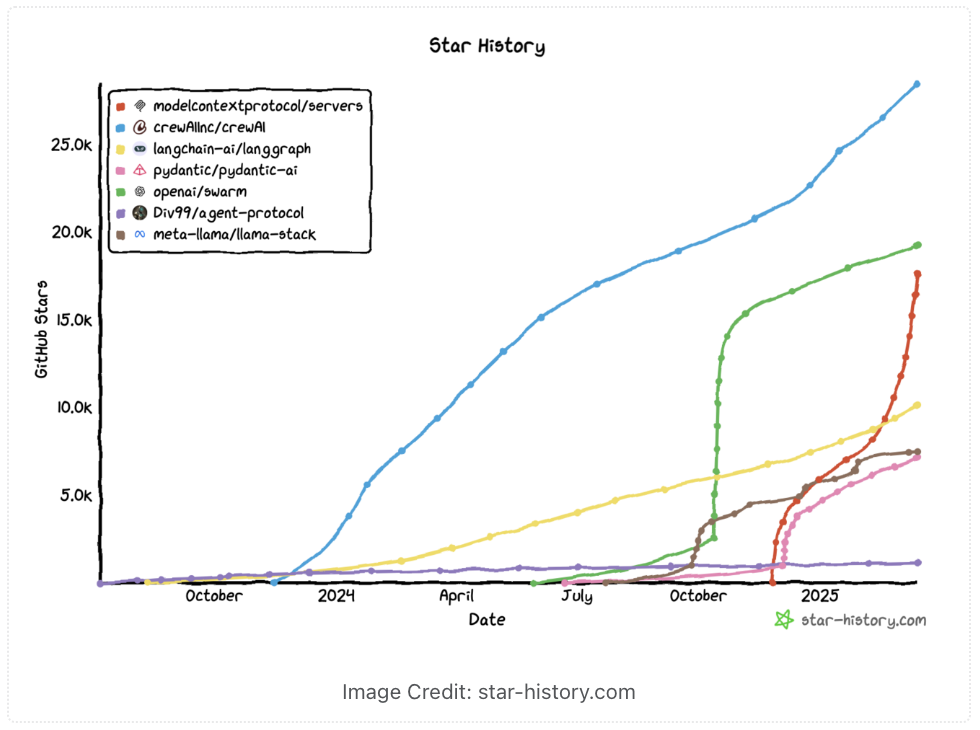

Nhưng rồi, một điều gì đó đã thay đổi. MCP hiện đang là một hiện tượng (trending), được cho là đã vượt mặt LangChain và hứa hẹn sẽ sớm qua mặt cả OpenAPI và CrewAI. Các "ông lớn" trong ngành AI và cộng đồng mã nguồn mở đang xôn xao bàn tán về MCP, xem nó như một yếu tố tiềm năng có thể thay đổi cuộc chơi trong việc xây dựng các hệ thống AI tự chủ (agentic AI systems). Tại sao lại có sự thay đổi đột ngột này?

Trong bài viết này, chúng ta sẽ "lặn sâu" vào MCP – tại sao nó lại là chủ đề nóng hổi ngay lúc này, MCP giúp thúc đẩy sự chuyển dịch sang AI tích hợp và nhận biết ngữ cảnh hơn như thế nào, vị trí của nó trong các quy trình làm việc tự chủ, và những chi tiết "ẩn sâu" mà các nhà phát triển, nhà nghiên cứu, kỹ sư AI, và các nhà quản lý công nghệ nên biết.

I. Tại Sao MCP Lại "Gây Sóng" Ngay Bây Giờ (Mà Không Phải Tháng 11 Năm Ngoái)?#

MCP được Anthropic mã nguồn mở và công bố lần đầu vào cuối tháng 11 năm 2024. Vào thời điểm đó, nó là một ý tưởng thú vị nhưng không nhiều người chú ý và xem xét nghiêm túc. Phải đến đầu năm 2025, MCP mới thực sự bùng nổ trong ý thức của cộng đồng AI. Có một vài lý do lớn cho sự "nổi sóng" gần đây này:

1. "Người Giải Quyết" Vấn Đề Tích Hợp:#

Các tác nhân AI và quy trình làm việc tự chủ (agentic workflows) đã trở thành những từ khóa "hot" trong năm 2023-2024, nhưng "gót chân Achilles" của chúng vẫn còn đó: tích hợp các tác nhân này với hệ thống kinh doanh và dữ liệu thực tế. Ban đầu, sự chú ý chủ yếu đổ dồn vào khả năng của mô hình và kỹ thuật prompting, chứ không phải tích hợp. MCP giải quyết trực tiếp khoảng trống này bằng cách định nghĩa "cách kết nối các nguồn dữ liệu hiện có" (hệ thống tệp, cơ sở dữ liệu, API, v.v.) vào quy trình làm việc của AI. Khi mọi người "tiêu hóa" được điều này, MCP bắt đầu được xem như mảnh ghép còn thiếu cho các tác nhân AI nghiêm túc, sẵn sàng cho môi trường sản xuất. (Đây cũng là một trong những nhận định từ hội nghị HumanX: "Trong những năm gần đây, chúng ta chủ yếu tập trung vào việc xây dựng các mô hình AI riêng lẻ... Nhưng khi sự phức tạp và nhu cầu tăng lên, một sự thay đổi đang diễn ra hướng tới các hệ thống tích hợp...")

2. Cộng Đồng và Sự Chấp Nhận Rộng Rãi:#

Chỉ trong vài tháng, MCP đã đi từ một khái niệm đến một hệ sinh thái đang phát triển mạnh mẽ. Những người tiên phong áp dụng bao gồm các công ty như Block (Square), Apollo, Zed, Replit, Codeium, và Sourcegraph, những công ty bắt đầu tích hợp MCP để tăng cường nền tảng của họ. Tiến nhanh đến năm 2025, và hệ sinh thái đã bùng nổ – đến tháng 2, đã có hơn 1.000 server (trình kết nối) MCP do cộng đồng xây dựng sẵn có. Rõ ràng, MCP đã chạm đúng "dây thần kinh" của ngành công nghiệp khi nó hướng tới AI tích hợp và nhận biết ngữ cảnh hơn. Hiệu ứng mạng (network effect) này càng làm tăng sức hấp dẫn của MCP: càng có nhiều công cụ sẵn có qua MCP, việc áp dụng tiêu chuẩn này càng trở nên hữu ích.

3. Động Lực Trở Thành Tiêu Chuẩn De Facto:#

Không giống như một SDK độc quyền khác hay một framework dùng một lần, MCP là mã nguồn mở, bất khả tri mô hình (model-agnostic), và được một "ông lớn" trong ngành AI hậu thuẫn. Điều này có nghĩa là bất kỳ mô hình AI nào (Claude, GPT-4, các LLM mã nguồn mở, v.v.) đều có thể sử dụng MCP, và bất kỳ nhà phát triển hay công ty nào cũng có thể tạo ra một tích hợp MCP mà không cần xin phép. Nhiều người trong cộng đồng hiện xem MCP như "người chiến thắng" tiềm năng trong cuộc đua tiêu chuẩn hóa cách các hệ thống AI kết nối với dữ liệu bên ngoài (tương tự như cách USB, HTTP, hay ODBC đã trở thành các tiêu chuẩn phổ biến trong lĩnh vực của chúng).

4. Sự Tiến Hóa Nhanh Chóng và Nỗ Lực "Truyền Bá":#

Anthropic không chỉ phát hành MCP rồi... bỏ đó. Họ đã tích cực cải tiến nó và hướng dẫn các nhà phát triển. Trong Hội nghị thượng đỉnh AI (AI Summit) gần đây, Mahesh Murag của Anthropic đã có một buổi workshop "gây sốt", làm tăng tốc độ áp dụng MCP.

II. Vậy MCP Là Gì và Nó Hoạt Động Ra Sao?#

Nói một cách đơn giản, MCP đặt ra các quy tắc rõ ràng về cách AI có thể tìm, kết nối và sử dụng các công cụ bên ngoài – dù đó là truy vấn cơ sở dữ liệu hay chạy một lệnh. Điều này cho phép các mô hình vượt ra ngoài dữ liệu huấn luyện của chúng, làm cho chúng linh hoạt hơn và nhận biết thế giới xung quanh tốt hơn.

Về mặt kỹ thuật, một trong những đặc điểm nổi bật của MCP là khả năng khám phá động (dynamic discovery) – các tác nhân AI tự động phát hiện các server MCP có sẵn và khả năng của chúng mà không cần tích hợp cứng (hard-coded integrations). Ví dụ, nếu bạn khởi chạy một server MCP mới (như cho một CRM), các tác nhân có thể ngay lập tức nhận diện và sử dụng nó thông qua một API được tiêu chuẩn hóa, mang lại sự linh hoạt mà các phương pháp truyền thống không thể sánh được.

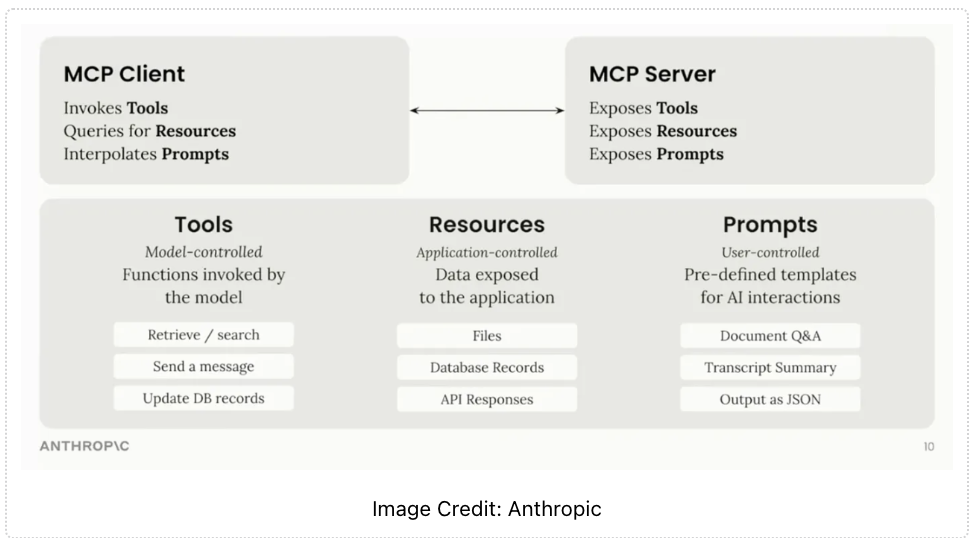

MCP xác định một số "nguyên tắc" (primitives) cơ bản cho tương tác:

- Công cụ (Tools): Các hàm có thể thực thi để AI thực hiện hành động (ví dụ: gọi API, ghi file).

- Tài nguyên (Resources): Nguồn dữ liệu chỉ đọc cung cấp ngữ cảnh (ví dụ: nội dung file, nhật ký).

- Lời nhắc (Prompts): Mẫu hoặc quy trình làm việc được xác định trước để hướng dẫn tương tác (ví dụ: lệnh gạch chéo).

Giao tiếp trong MCP thường dựa trên kiến trúc Client-Server (với Host là ứng dụng AI chính), sử dụng JSON-RPC 2.0 qua các lớp vận chuyển như Stdio (cho cục bộ) hoặc HTTP với SSE (cho từ xa).

III. Bắt Tay Với MCP: Khởi Đầu Thực Tế#

Nơi tốt nhất để bắt đầu là tài liệu và kho lưu trữ MCP chính thức. Anthropic đã mã nguồn mở đặc tả và cung cấp SDK (bằng các ngôn ngữ như Python và giờ đây có cả Java). Các bước điển hình là:

- Chạy hoặc cài đặt một MCP server cho công cụ hoặc nguồn dữ liệu bạn quan tâm. Anthropic có một kho lưu trữ mã nguồn mở các server dựng sẵn cho các hệ thống phổ biến (Google Drive, Slack, Git, cơ sở dữ liệu, v.v.). Bạn có thể cài đặt và cấu hình chúng (thường chỉ cần chạy một lệnh với thông tin xác thực hoặc khóa của bạn).

- Thiết lập MCP client trong ứng dụng AI của bạn. Nếu bạn đang sử dụng ứng dụng của Claude, bạn có thể thêm server trong giao diện người dùng. Nếu bạn đang tự viết mã cho tác nhân của mình, hãy sử dụng SDK MCP để kết nối với server (cung cấp địa chỉ/cổng).

- Khi bạn đã kích hoạt các dịch vụ MCP trong client của mình, client sẽ nhận diện các chức năng bổ sung được cung cấp: các công cụ, tài nguyên và mẫu lời nhắc mới.

- Gọi và lặp lại. Mô hình/tác nhân giờ đây có thể gọi các hành động của công cụ MCP khi cần. Hãy đảm bảo theo dõi nhật ký (logs) để xem nó có đang gọi các server một cách chính xác không. Bạn sẽ thấy các yêu cầu đến server MCP và các phản hồi trả về.

Để bắt đầu nhanh, Anthropic khuyên bạn nên thử tích hợp Claude Desktop (nếu bạn có quyền truy cập) hoặc chạy các server ví dụ và sử dụng hướng dẫn nhanh của họ. Cộng đồng cũng rất năng động – có một danh mục các server MCP đang mở rộng nhanh chóng. Một số server phổ biến bao gồm trình kết nối cho các dịch vụ của Google (Drive, Gmail, Lịch), Slack (chat và truy cập tệp), GitHub/Git (cho kho mã), các cơ sở dữ liệu như Postgres, trình duyệt web hoặc Puppeteer (để duyệt các trang web), và nhiều hơn nữa.

(Cảm ơn Will Schenk đã làm rõ một vài điều về MCP và cách bắt đầu với nó. Anh ấy đã chia sẻ một hướng dẫn thực hành nhanh với dịch vụ giám sát Tesla của Tezlab để minh họa MCP hoạt động.)

IV. Trước Khi Có MCP: Bối Cảnh Xử Lý Ngữ Cảnh và Công Cụ#

Hãy cùng nhìn lại các phương pháp truyền thống để cung cấp kiến thức hoặc khả năng hành động bên ngoài cho AI, và MCP khác biệt như thế nào:

- Tích hợp API tùy chỉnh (Trình kết nối dùng một lần): Phương pháp phổ biến nhất là viết mã tùy chỉnh hoặc sử dụng SDK cho từng dịch vụ. Ví dụ, nếu bạn muốn tác nhân AI của mình truy cập Google Drive và một cơ sở dữ liệu SQL, bạn sẽ tích hợp API của Google và một trình điều khiển cơ sở dữ liệu riêng biệt, mỗi cái có cách xác thực, định dạng dữ liệu và những điểm "kỳ quặc" riêng. Thật là một cực hình! Ngược lại, MCP cung cấp một "chìa khóa" (giao thức) duy nhất có thể mở nhiều cánh cửa, và các server MCP mới có thể được thêm vào mà không cần thay đổi client.

- Plugin Mô hình Ngôn ngữ (Plugin OpenAI, v.v.): Một phương pháp khác được giới thiệu vào năm 2023 là cung cấp cho mô hình một đặc tả plugin được tiêu chuẩn hóa (thường là một lược đồ OpenAPI) để nó có thể gọi các API bên ngoài một cách có kiểm soát (ví dụ: hệ thống Plugin ChatGPT). Mặc dù về mặt khái niệm tương tự MCP (tiêu chuẩn hóa quyền truy cập công cụ), chúng lại độc quyền và hạn chế – mỗi plugin vẫn cần được xây dựng và host riêng lẻ, và chỉ một số nền tảng nhất định (như ChatGPT hoặc Bing Chat) mới có thể sử dụng chúng. Các plugin cũng có xu hướng tập trung vào việc truy xuất dữ liệu một chiều (mô hình gọi API và nhận thông tin) thay vì duy trì một phiên tương tác liên tục. MCP nổi bật bởi tính mã nguồn mở và phổ quát (bất kỳ ai cũng có thể triển khai, không bị ràng buộc với một nhà cung cấp AI nào) và bằng cách hỗ trợ các tương tác hai chiều phong phú.

- Sử dụng Công cụ qua Framework (Công cụ LangChain, Tác nhân): Các thư viện điều phối tác nhân như LangChain đã phổ biến hóa ý tưởng cung cấp cho mô hình các "công cụ" (hàm) với mô tả. Tuy nhiên, mỗi công cụ vẫn yêu cầu triển khai tùy chỉnh "bên dưới". MCP có thể được xem là bổ sung ở đây: nó cung cấp một giao diện được tiêu chuẩn hóa cho việc triển khai các công cụ. LangChain tạo ra một tiêu chuẩn hướng tới nhà phát triển (developer-facing). MCP tạo ra một tiêu chuẩn hướng tới mô hình (model-facing) – chính tác nhân AI đang chạy có thể khám phá và sử dụng bất kỳ công cụ nào được MCP định nghĩa trong thời gian chạy. Thực tế, các ý tưởng này đang hội tụ: ví dụ, đội ngũ LangChain (khi nhận thấy sự trỗi dậy của MCP) đã cung cấp một bộ điều hợp (adapter) để tất cả các server MCP đó có thể được coi như các công cụ LangChain một cách dễ dàng.

- Truy xuất Tăng cường Tạo sinh (RAG) và Cơ sở dữ liệu Vector: Một cách phổ biến để cung cấp ngữ cảnh cho LLM. Tuy nhiên, RAG thường xử lý các đoạn văn bản tĩnh và không cho phép mô hình thực hiện hành động hoặc truy vấn ngoài những gì đã được lập chỉ mục. MCP có thể hoạt động cùng với RAG – ví dụ, một server MCP có thể giao tiếp với một cơ sở dữ liệu vector, cho phép mô hình đưa ra các truy vấn tìm kiếm như một công cụ. Có thể nói MCP là một cơ chế tổng quát hơn: RAG cung cấp ngữ cảnh thụ động, còn MCP cho phép mô hình chủ động lấy hoặc hành động dựa trên ngữ cảnh thông qua các kênh được xác định.

V. MCP Có Phải Là "Viên Đạn Bạc" Giải Quyết Mọi Vấn Đề?#

Tất nhiên, MCP không phải là "viên đạn bạc", nó là một lớp tích hợp cực kỳ tiện lợi. Nhưng giống như bất kỳ công nghệ mới nổi nào, nó cũng đi kèm với những phức tạp và thách thức riêng:

- Chi phí quản lý server: Việc chạy và duy trì kết nối đến nhiều server công cụ có thể khá cồng kềnh, đặc biệt trong môi trường sản xuất.

- Thiết kế ban đầu cho local/desktop: Đặt ra câu hỏi về khả năng dịch chuyển sang kiến trúc đám mây và kịch bản đa người dùng.

- Khả năng sử dụng công cụ: Việc MCP mở rộng bộ công cụ không đồng nghĩa với việc mô hình sẽ sử dụng chúng hiệu quả. Chất lượng mô tả công cụ và khả năng diễn giải của AI vẫn là yếu tố then chốt.

- Độ trưởng thành: Là một công nghệ tương đối mới, nó có thể có những thay đổi đột phá (breaking changes), đòi hỏi cập nhật thường xuyên.

- Tính tương thích: Hiện tại, MCP được hỗ trợ hạng nhất trong hệ sinh thái của Anthropic (ví dụ: Claude), nhưng việc áp dụng rộng rãi hơn vẫn chưa chắc chắn.

- Có thể là "quá mức cần thiết" (overkill) cho các ứng dụng đơn giản.

- Bảo mật và giám sát: Cần các biện pháp kiểm soát xác thực và cấp quyền mạnh mẽ. Các sáng kiến mã nguồn mở như MCP Guardian đã xuất hiện để giải quyết vấn đề này.

Nhìn chung, không có giới hạn nào trong số này là không thể vượt qua, nhưng việc bắt đầu với các triển khai thử nghiệm hoặc không quan trọng để làm quen là điều khôn ngoan. Một trong những điều tốt nhất về MCP là cộng đồng gắn kết.

VI. MCP Trong Điều Phối Tác Nhân và Vị Trí Trong Quy Trình Tự Động#

MCP không phải là một "framework tác nhân"; đúng hơn, nó hoạt động như một lớp tích hợp được tiêu chuẩn hóa cho các tác nhân. MCP tập trung vào phần Hành động (Action) – cụ thể là cung cấp cho các tác nhân một cách chuẩn hóa để thực hiện các hành động liên quan đến dữ liệu hoặc công cụ bên ngoài. Nó cung cấp "đường ống" kết nối một tác nhân AI với thế giới bên ngoài một cách an toàn, có cấu trúc.

Quan trọng là phải nhấn mạnh lại rằng MCP không phải là một công cụ điều phối (orchestration engine) hay bộ não của tác nhân. Thay vào đó, nó là một lớp tích hợp trong kiến trúc tự chủ. Nó bổ sung cho các công cụ điều phối tác nhân như LangChain, LangGraph, CrewAI, hoặc LlamaIndex bằng cách phục vụ như một "hộp công cụ" thống nhất mà từ đó các tác nhân AI có thể gọi các hành động bên ngoài.

VII. Những Khả Năng Mới Được MCP Mở Ra#

MCP vẫn còn mới, và tiềm năng đầy đủ của nó chỉ mới bắt đầu được khám phá. Làn sóng các trường hợp sử dụng đầu tiên là rõ ràng – kết nối dữ liệu doanh nghiệp với trợ lý chat hoặc tăng cường các tác nhân mã hóa với quyền truy cập kho lưu trữ. Nhưng một số ứng dụng mới nổi có thể đưa các tác nhân AI lên một tầm cao mới:

- Quy trình làm việc đa bước, liên hệ thống: Ví dụ, một AI lên kế hoạch sự kiện: kiểm tra lịch, đặt địa điểm, gửi email cho khách, sắp xếp chuyến đi, và cập nhật bảng ngân sách. Với MCP, tất cả các hành động này diễn ra thông qua một giao diện duy nhất.

- Tác nhân hiểu môi trường của chúng (bao gồm Robotics): MCP có thể cho phép các tác nhân AI được nhúng trong môi trường thông minh – dù ở nhà thông minh hay hệ điều hành – tương tác với cảm biến, thiết bị IoT, hoặc các hàm của HĐH thông qua các server MCP được tiêu chuẩn hóa.

- Các Tác nhân Hợp tác (Xã hội Tác nhân - Agent Societies): MCP có thể phục vụ như một không gian làm việc chung cho các hệ thống đa tác nhân. Các tác nhân AI chuyên biệt – một cho nghiên cứu, một cho lập kế hoạch, một cho thực thi – có thể sử dụng MCP để trao đổi thông tin và phối hợp nhiệm vụ một cách linh hoạt.

- Trợ lý AI Cá nhân với Tích hợp Sâu: MCP có thể cho phép người dùng cấu hình AI của riêng họ để tương tác với dữ liệu và ứng dụng cá nhân một cách an toàn.

- Quản trị và Bảo mật Doanh nghiệp: Đối với doanh nghiệp, MCP tiêu chuẩn hóa quyền truy cập của AI vào các công cụ nội bộ, giảm chi phí tích hợp. Nó cũng cho phép quản trị: các tương tác AI có thể được ghi lại, giám sát và kiểm soát.

VIII. Tổng Kết và Hướng Đi Tới#

MCP đang nhanh chóng trưởng thành thành một giao thức tiêu chuẩn mạnh mẽ, biến AI từ một "bộ não" cô lập thành một "người thực thi" linh hoạt. Bằng cách hợp lý hóa cách các tác nhân kết nối với các hệ thống bên ngoài, nó mở đường cho các quy trình làm việc AI có năng lực hơn, tương tác tốt hơn và thân thiện với người dùng hơn.

Các Tính Năng Sắp Tới Quan Trọng (dựa trên workshop của Mahesh Murag từ Anthropic):

- Server Từ xa & OAuth: Lưu trữ từ xa liền mạch bằng SSE. OAuth 2.0 tích hợp sẵn để tích hợp an toàn (ví dụ: Slack).

- Kho đăng ký MCP Chính thức: Khám phá và xác minh server tập trung. Thân thiện với doanh nghiệp: host có thể chạy các kho đăng ký riêng.

- Điểm cuối Well-Known: Các tệp

.well-known/mcpđược tiêu chuẩn hóa để khám phá server của bên thứ nhất. - Các Cải tiến Khác: Hỗ trợ streaming, kết nối stateless, hành vi server chủ động, và namespace tốt hơn.

Mỗi bản cập nhật sẽ làm cho MCP mạnh mẽ hơn, giúp các tác nhân AI tích hợp sâu hơn vào các quy trình làm việc thực tế. Đây là một nỗ lực do cộng đồng thúc đẩy, vì vậy hãy theo dõi lộ trình, tham gia thảo luận và giúp định hình tương lai của cách AI và phần mềm giao nhau.

(MCP đã "nổi sóng" đến mức chúng tôi thậm chí phải thay đổi lịch biên tập cho nó. Chủ đề này thực sự cần được giải thích!)